MS Fabric und der Trend zur holistischen BI Plattform

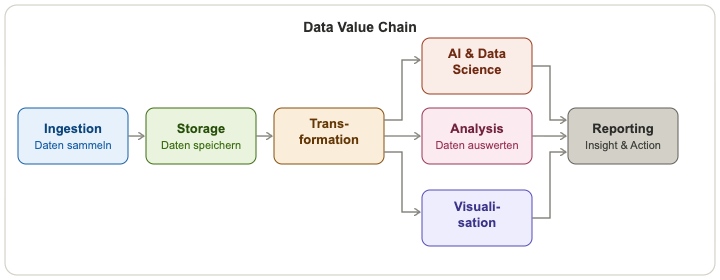

MS Fabric, Microsofts Plattform zur Datenaufbereitung, -speicherung und -visualisierung wurde 2023 veröffentlicht. Die inzwischen knapp drei Jahre alte Plattform hat viele der anfänglichen Probleme hinter sich gelassen und ist heute ziemlich relevant und verlässlich. Zuletzt kündigten viele der Wettbewerber (etwa Snowflake, Tableau und Databricks) an, einen ähnlichen Ansatz zu verfolgen, wie es Microsoft hier bereits einige Jahre zuvor gemacht hat: den Fokus von einzelnen spezialisierten Tools in der Data Value Chain zu Tools zu verschieben, die sämtliche Bereiche abdecken sollen.

Wieso gibt es Fabric?

Die ursprüngliche Idee von Fabric gründet sich auf zwei Microsoft Produkten, Azure, Microsofts Cloud Computing Plattform, und Power BI, dem spezialisierten Datenvisualisierungstool. Fabric wurde mit dem Ziel konzipiert, ausgewählte Komponenten von Azure in die PBI Welt zu integrieren und so eine ganzheitliche Data Analytics Plattform zu schaffen.

Inzwischen ist PBI ein Bestandteil von Fabric und arbeitet sehr gut mit anderen Fabric Komponenten zusammen, auch wenn man an vielen Stellen erkennen kann, dass es ursprünglich ein eigenständiges Tool war – es lässt sich bis heute auch noch vollständig ohne andere Fabric Services nutzen.

Konsolidierung: Alle wollen die ganze Data Value Chain

Vor allem durch die Entwicklungen im Bereich Gen AI, auf die hier nicht detailliert eingegangen werden soll, erkannten viele andere Unternehmen im Bereich der Datenverarbeitung den Wert einer solchen generalistischen Plattform anstelle von einzelnen spezialisierten Tools. So fokussiert Snowflake, ursprünglich ein Cloud Data Warehouse, immer mehr Energie darauf, auch Datenvisualisierung und Analyse direkt in die Plattform zu integrieren. Databricks, ursprünglich mit dem Fokus auf effizienter Datentransformation, geht einen ähnlichen Weg. Und auch Tableau, bzw. der Mutterkonzern Salesforce, versucht mit Tableau NEXT eine Plattform zu erschaffen, die weit über das hinausgeht, was das klassische Tableau abdeckt.

Fabric hat hier also scheinbar einen Trend gestartet: Immer mehr Tools wollen die gesamte Data Value Chain abdecken, anstatt sich auf einzelne Bereiche zu spezialisieren. Für uns Konsumenten dieser Tools hat das sowohl Vorteile, als auch einige Nachteile, deren man sich bewusst sein sollte.

Was der Markt dir nicht abnimmt

Grundsätzlich ist es äußerst praktisch, wenn man sich nicht mehr einen ganzen Toolstack heranholen muss und beispielsweise von Tableau, Snowflake und Alteryx zu Fabric migrieren kann, und damit viel Aufwand im Verwalten der einzelnen Tools einspart.

Aber, auch wenn Fabric oberflächlich alle Kernbereiche der hier angegebenen Tools abdeckt, tut es das nicht mit der selben Qualität. Die Datenspeicher und KI Optionen können nicht mit Snowflake mithalten, die Datenvisualisierungsmöglichkeiten haben nicht die zugrundeliegende Genialität von Tableau und die Low-Code Optionen unterliegen Alteryx deutlich. Es gibt also einen Trade-off zwischen Qualität und Einfachheit sowie Kosten.

Der Trade-off zwischen Toolbreite und Spezialisierung

Auch auf die Rollen in einem Unternehmen hat das einen deutlichen Einfluss. In einem Unternehmen, welches auf Snowflake zur Datenspeicherung und -verarbeitung und Tableau zur Datenvisualisierung setzt, lassen sich Rollen oft gut trennen. Data Engineers erledigen das Modellieren, Speichern und Transformieren der Daten, während Datenanalysten das Visualisieren und Darstellen von Daten durchführen.

In dieser – stark vereinfachten – Rollenverteilung ist es klar, wer welche Aufgaben übernimmt, aber die Kommunikation zwischen diesen zwei Personen, bzw. Abteilungen muss gut funktionieren. Wenn der Tableau-Experte wochenlang auf elementare Änderungen in der Datenbank warten muss, frustriert das schnell. Anders herum muss der Data Engineer gut wissen, wie Datenmodelle effizient gestaltet sind, damit Reporting und Konsum der Daten reibungslos funktionieren. In diesem Modell ist Kommunikation also noch wichtiger als ohnehin schon.

Wenn Rollen generalistischer werden

In einer ganzheitlichen Plattform kann es sich ähnlich darstellen, wenn strikte Aufgaben definiert sind. Allerdings bietet es sich hier auch an, die Prozesse von Data Ingestion, Transformation, Speicherung und Reporting ganzheitlich zu betrachten. Das führt aber zwangsläufig zum gleichen Trade-off, der bereits bei den Tools beschrieben wurde: Die Rollen werden generalistischer und weniger spezialisiert.

Kommunikation wird einfacher, da Teams einen breiteren Überblick über die ganze Plattform bekommen, aber einzelne Aufgaben können vermutlich nicht mit der gleichen Energie und Fokussierung umgesetzt werden, da das spezialisierte Wissen sowie die Möglichkeiten fehlen. Diese Entwicklung spiegelt einen breiteren Trend wider, der in der Branche unter dem Begriff Analytics Engineering bekannt ist – die Verschmelzung von Data Engineering und Analyse in einer einzigen Rolle.

Governance wird in Plattformumgebungen noch wichtiger

Mehr Möglichkeiten bedeuten auch mehr Möglichkeiten, etwas falsch zu machen – gerade weil der ganzheitliche Blick auf die Plattform dazu verleitet, schnell viel aufzubauen. So kann ein Fabric-Deployment schnell darin ausarten, dass unzählige Lakehouses entstehen und niemand mehr genau weiß, wo welche Daten zu finden sind. Strenge Governance, Dokumentation und Absprache über die Prozesse wird hier daher wieder wichtig.

Vendor Lock in als strategische Abwägung

Ein substanzieller Nachteil einer einzelnen Plattformlösung ist natürlich auch der Vendor-Lock-in. Hier entsteht eine einseitige Abhängigkeit von den Entwicklungen des Anbieters. Wenn dieser das Produkt nicht wie erwartet weiterentwickelt oder Preise unerwartet anhebt, ist ein Ausstieg schwierig.

Fazit: Die optimale Architektur für Deine Datenstrategie finden

Eine optimale Lösung gibt es nicht und jedes Unternehmen muss selbst beurteilen, welche Option für sie am besten geeignet ist. Der Markt für Data Analytics und BI bewegt sich stark darauf zu, dass es ganzheitliche Lösungen von verschiedenen Playern gibt. Als Konsumenten sollten wir das allerdings nicht als Signal verstehen, dass dies die beste Lösung ist – einzelne spezialisierte Tools können immer noch deutlich geeigneter für die eigenen Bedürfnisse sein.

Ganz besonders im Bereich der KI lassen sich Systeme inzwischen durch MCP-Connectoren exzellent verknüpfen, so dass nicht auf die oft teuren KI-Features der großen Plattformanbieter zurückgegriffen werden muss.

Welche Datenstrategie passt zu Euch?

Wenn Ihr vor der Frage steht, ob Microsoft Fabric, ein spezialisierter Toolstack oder eine hybride Architektur besser zu Eurer Datenstrategie passt, unterstützen wir Euch gerne. Gemeinsam analysieren wir Eure bestehende BI und Analytics Landschaft, bewerten relevante Plattformen und entwickeln ein Setup, das zu Euren Prozessen, Teams und Anforderungen passt.

Oder ruft uns einfach an: 040 2109 1818-0